- Contenu

- Présentation personnelle et projet de stage

- Rapport

- Jour 1: Lundi 30 mars 2026

- Jour 2: Mardi 31 mars 2026

- Jour 3: Mercredi 01 avril 2026

- Jour 4: Jeudi 02 avril 2026

- Jour 5: Vendredi 03 avril 2026

- Jour 6: Lundi 06 avril 2026

- Jour 7: Mardi 07 avril 2026

- Jour 8: Mercredi 08 avril 2026

- Jour 9: Jeudi 09 avril 2026

- Jour 10: Vendredi 10 avril 2026

- Jour 11: Lundi 13 avril 2026

- Jour 12: Mardi 14 avril 2026

- Jour 13: Mercredi 15 avril 2026

- Jour 14: Jeudi 16 avril 2026

- Jour 15: Vendredi 17 avril 2026

- Jour 16: Lundi 20 avril 2026

- Jour 17: Mardi 21 avril 2026

- Jour 18: Mercredi 22 avril 2026

- Jour 19: Jeudi 23 avril 2026

- Jour 20: Vendredi 24 avril 2026

- Jour 21: Lundi 27 avril 2026

- Jour 22: Mardi 28 avril 2026

- Jour 23: Mercredi 29 avril 2026

- Jour 24: Jeudi 30 avril 2026

- Jour 25: Vendredi 01 mai 2026

- Jour 26: Lundi 04 mai 2026

- Jour 27: Mardi 05 mai 2026

- Jour 28: Mercredi 06 mai 2026

- Jour 29: Jeudi 07 mai 2026

- Jour 30: Vendredi 08 mai 2026

- Jour 31: Lundi 11 mai 2026

- Jour 32: Mardi 12 mai 2026

- Jour 33: Mercredi 13 mai 2026

- Jour 34: Jeudi 14 mai 2026

- Jour 35: Vendredi 15 mai 2026

- Jour 36: Lundi 18 mai 2026

- Jour 37: Mardi 19 mai 2026

- Jour 38: Mercredi 20 mai 2026

- Jour 39: Jeudi 21 mai 2026

- Jour 40: Vendredi 22 mai 2026

- Jour 41: Lundi 25 mai 2026

- Jour 42: Mardi 26 mai 2026

- Jour 43: Mercredi 27 mai 2026

- Jour 44: Jeudi 28 mai 2026

- Jour 45: Vendredi 29 mai 2026

- Jour 46: Lundi 01 juin 2026

- Jour 47: Mardi 02 juin 2026

- Jour 48: Mercredi 03 juin 2026

- Jour 49: Jeudi 04 juin 2026

- Jour 50: Vendredi 05 juin 2026

- Jour 51: Lundi 08 juin 2026

- Jour 52: Mardi 09 juin 2026

- Jour 53: Mercredi 10 juin 2026

- Jour 54: Jeudi 11 juin 2026

- Jour 55: Vendredi 12 juin 2026

- Jour 56: Lundi 15 juin 2026

- Jour 57: Mardi 16 juin 2026

- Jour 58: Mercredi 17 juin 2026

- Jour 59: Jeudi 18 juin 2026

- Jour 60: Vendredi 19 juin 2026

- Jour 61: Lundi 22 juin 2026

- Jour 62: Mardi 23 juin 2026

- Jour 63: Mercredi 24 juin 2026

- Jour 64: Jeudi 25 juin 2026

- Jour 65: Vendredi 26 juin 2026

- Jour 66: Lundi 29 juin 2026

- Jour 67: Mardi 30 juin 2026

- Jour 68: Mercredi 01 juillet 2026

- Jour 69: Jeudi 02 juillet 2026

- Jour 70: Vendredi 03 juillet 2026

- Jour 71: Lundi 06 juillet 2026

- Jour 72: Mardi 07 juillet 2026

- Jour 73: Mercredi 08 juillet 2026

- Jour 74: Jeudi 09 juillet 2026

- Jour 75: Vendredi 10 juillet 2026

- Jour 76: Lundi 13 juillet 2026

- Jour 77: Mardi 14 juillet 2026

- Jour 78: Mercredi 15 juillet 2026

- Jour 79: Jeudi 16 juillet 2026

- Jour 80: Vendredi 17 juillet 2026

- Jour 81: Lundi 20 juillet 2026

- Jour 82: Mardi 21 juillet 2026

- Jour 83: Mercredi 22 juillet 2026

- Jour 84: Jeudi 23 juillet 2026

- Jour 85: Vendredi 24 juillet 2026

- Jour 86: Lundi 27 juillet 2026

- Jour 87: Mardi 28 juillet 2026

- Jour 88: Mercredi 29 juillet 2026

- Jour 89: Jeudi 30 juillet 2026

- Jour 90: Vendredi 31 juillet 2026

Présentation personnelle et projet de stage¶

Je suis Nicolas Schmauch

Je suis un étudiant en Licence Pro ADSILLH (Administration et Développement de Systèmes Informatiques à base de Logiciels Libres et Hybrides).

Je suis en stage avec Yoan Gabriel (4 mois de stage du 30 mars au 31 juillet 2026).

Rapport¶

Jour 1: Lundi 30 mars 2026¶

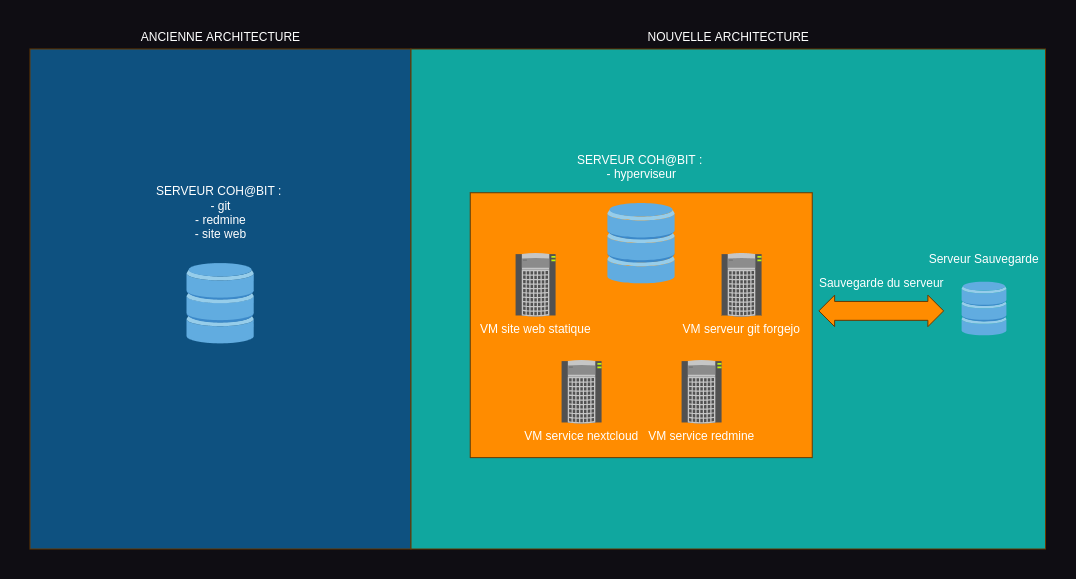

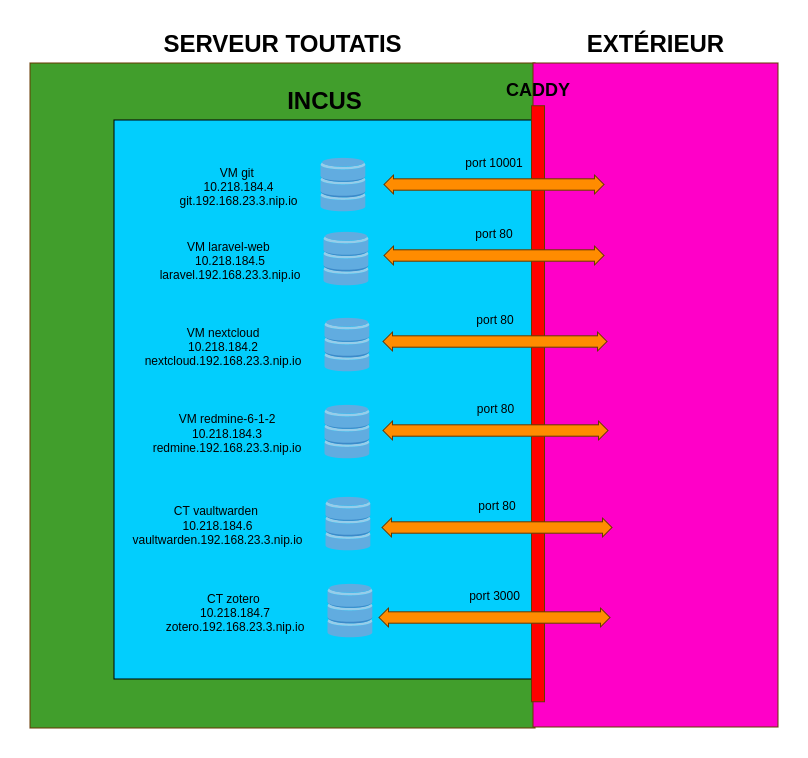

Notre travail consiste à mettre à jour l’ancienne architecture vers une nouvelle, basée sur Debian Trixie stable, avec un hyperviseur permettant de gérer différentes machines virtuelles (une VM par service).

| SCHEMA |

|---|

|

Nous avons tout d’abord dû choisir un hyperviseur parmi les différentes solutions open source :

| Caractéristique | Incus (Mode VM) | KVM/QEMU + libvirt | Canonical LXD (Mode VM) | Xen Project |

|---|---|---|---|---|

| Moteur | QEMU / KVM | QEMU / KVM | QEMU / KVM | Xen Hypervisor |

| Installation Debian 13 | Native apt install incus |

Native apt install libvirt-daemon |

Via Snap snap install lxd |

Native apt install xen-hypervisor |

| RAM | Très faible (~50 Mo) | Faible (~100 Mo) | Moyen (~200 Mo) | Élevé (minimum 1024 Mo) |

| Déploiement OS | Images Cloud et Manuel | Manuel (Fichiers ISO) | Images Cloud et Manuel | Manuel (ISO ou debootstrap) |

| Sauvegardes / Snapshots | Intégrés (incus snapshot / export) | Manuels (virsh snapshot-create) | Intégrés (lxc snapshot) | Complexes (via LVM) |

| Score global / 5 | 5 / 5 | 4 / 5 | 3 / 5 | 1 / 5 |

sources :

https://linuxcontainers.org

https://libvirt.org

https://canonical.com/lxd

https://xenproject.org/resources

https://wiki.debian.org/Incus

https://wiki.debian.org/KVM

https://wiki.debian.org/QEMU

https://wiki.debian.org/libvirt

https://wiki.debian.org/Xen/InstallBootConfig

https://wiki.xenproject.org/wiki/Tuning_Xen_for_Performance

https://dev.to/rosgluk/linux-virtualization-solutions-a-complete-comparison-guide-196g

https://www.siberoloji.com/how-to-install-and-configure-lxd-on-debian-12

Nous avons ensuite calculé les ressources nécessaires pour savoir si le serveur a besoin d’une amélioration de ses ressources ou non :

| Service | RAM minimum | RAM recommandée | CPU minimum | CPU recommandé |

|---|---|---|---|---|

| Apache | 512 MB | 1–4 GB | 1 core | 2+ cores |

| Nginx | 512 MB | 1 GB | 1 core | 2+ cores |

| Laravel | 1 GB | 2+ GB | 1 core | 2+ cores |

| Redmine | 512 MB | 1–2 GB | 1 core | 2 cores |

| Forgejo | 512 MB | 2 GB | 1 core | 2+ cores |

| NextCloud | 512 MB | 2 GB | 1 core | 2+ cores |

| total | 3.5 GB | 9-13+ GB | 6 cores | 12+ cores |

sources :

https://httpd.apache.org/docs/2.4/misc/perf-tuning.html

https://docs.nginx.com/nginx-agent/technical-specifications

https://kinsta.com/fr/blog/installer-nginx

https://www.hostragons.com/fr/blog/exigences-dhebergement-pour-les-applications-laravel

https://redmine1click.com/requirements

https://blog.stephane-robert.info/docs/services/devops/forgejo/installation

https://docs.nextcloud.com/server/stable/admin_manual/installation/system_requirements.html

| Critère clé | Caddy | Nginx Proxy Manager (NPM) | Traefik |

|---|---|---|---|

| Consommation Mémoire (RAM) | Très léger | Lourd | Léger |

| Automatisation SSL | Natif, Zéro config | Bouton dans l'interface | Demande une config YAML |

| Adaptation à un réseau de VM | Fichier texte très lisible | Routage IP via interface | Usine à gaz sans Docker |

| Facilité de prise en main | Syntaxe minimaliste | Interface web complète | Courbe d'apprentissage rude |

| Score global / 5 | 4 / 5 | 3 / 5 | 1 / 5 |

sources :

https://kx.cloudingenium.com/en/caddy-reverse-proxy-automatic-https-zero-config-ssl-guide/

https://caddyserver.com/docs/quick-starts/reverse-proxy

https://caddyserver.com/docs/

https://stackoverflow.com/questions/63077100/how-much-memory-and-cpu-nginx-and-nodejs-in-each-container-needs

https://nginxproxymanager.com/

https://community.traefik.io/t/traefik-performance-lags-behind-nginx-and-caddy/28919

https://doc.traefik.io/traefik/routing/overview/

https://www.reddit.com/r/selfhosted/comments/1odh46j/nginx_vs_caddy_vs_traefik_benchmark_results/

Jour 2: Mardi 31 mars 2026¶

Mail pour Alexander :

Bonjour Alexander, Nous sommes les nouveaux stagiaires ADSILLH. Pour le projet du nouveau serveur, on a fait des comparatifs (Yoan et moi), pour la nouvelle architecture et on propose : Hyperviseur : Incus (Mode VM), car il offre la consommation RAM la plus faible, s'installe nativement sur Debian et la gestion des snapshots et plus simple qu'avec KVM. Reverse Proxy : Caddy, car très léger et automatise à 100% la gestion des certificats SSL avec Let's Encrypt. Il est plus adapté que Traefik ou Nginx Proxy Manager pour des VM fixes. Voici nos comparatifs : https://projets.cohabit.fr/redmine/projects/accueil/wiki/Nicolas_Schmauch_2 Schmauch Nicolas

Jour 3: Mercredi 01 avril 2026¶

La réponse d'Alexander :

Du coup, les questions qui restent en suspens sont : Il faut que cela gère le raid logiciel (1 ou 5). Quelle technologie sont supportées pour les containers ? Et les Snapshots ou image des VM sont-elles exportables dans un format qui est géré par la plupart des hyperviseurs en cas de soucis ?

Notre réponse :

Incus est compatible avec le raid logiciel (1 ou 5), il ne gère pas le matériel directement, il faut juste lui indiquer d'utiliser le volume créé. Incus utilise des conteneurs système (LXC) et il gère Docker soit en l'installant à l'intérieur d'une VM/conteneur (mode nesting), soit en lançant des images Docker (images OCI). Les VM Incus sont basées sur QEMU et sont exportées au format QCOW2 ou Raw. Donc c'est compatible avec la plupart des hyperviseurs comme Proxmox, KVM, VirtualBox, VMware, etc. Conteneur + dir = Dossier VM QEMU + dir = raw VM QEMU + lvm = qcow2

Commande Incus :incus launch images:debian/13 ma-vm-debian --vm : Lance un VM Debian 13incus remote add docker https://docker.io --protocol=oci : Pour ajouter le dépôt Docker Hubincus launch docker:nginx mon-nginx : Lance l'image nginx

incus list : Voir toutes les instancesincus stop mon-instance : Arrête une instanceincus start mon-instance : Démarrer une instanceincus restart mon-instance : Redémarrer une instance

incus delete mon-instance : Supprimer une instance arrêtéeincus delete mon-instance --force : Forcer l'arrêt et la suppression

incus snapshot create mon-instance mon-snap1 : Créer un snapshot de l'instance--stateful pour sauvegarder la RAM à chaud

fonctionne que si migration.stateful=true est activé, pour l'activer :incus config set mon-instance migration.stateful=true

incus snapshot list mon-instance : Voir toutes les snapshots d'une instances

incus snapshot create mon-instance mon-snap1 --reuse--reuse supprime l'ancien mon-snap1 et recréer un nouveau avec le même nom

incus snapshot restore mon-instance mon-snap1 : Restore un snapshot pour une instance

Recommandé d'arrêter l'instance avec incus stop avant de restaurer

incus snapshot delete mon-instance mon-snap1 : Supprimer un snapshot

incus launch images:debian/13 ma-vm --vm -c limits.cpu=4 -c limits.memory=8GiB -d root,size=50GiB : -c (la config) -d (le disque)

Modifier les ressources d'une instance déjà existante :incus config set mon-instance limits.memory 4GiB : Modifier la RAMincus config set mon-instance limits.memory.swap false : Désactiver le swapincus config set mon-instance limits.cpu 2 : Alloue 2 coeurs cpuincus config set mon-instance limits.cpu.allowance 50% : Bride la puissance des coeurs à 50% d'utilisation

Voir la config d'une instance :incus config show mon-instanceincus config device show mon-instanceincus info mon-instance

Jour 4: Jeudi 02 avril 2026¶

| Partition | Taille | Point de montage | Rôle |

| 1 | 512 Mo | /boot/efi | Pour le démarre en UEFI |

| 2 | 1 Go | /boot | Pour le boot Debian |

| 3 | 8 Go | swap | Sécurité si la RAM sature (à voir car jsp si c'est vraiment utile car on a 32go) |

| 4 | 50 Go | / (Racine) | Le Debian de l'hyperviseur, Incus et logs |

| 5 | ~940 Go | Aucun | Espace brut (Ne pas formater car on initialisera avec Incus en ZFS) |

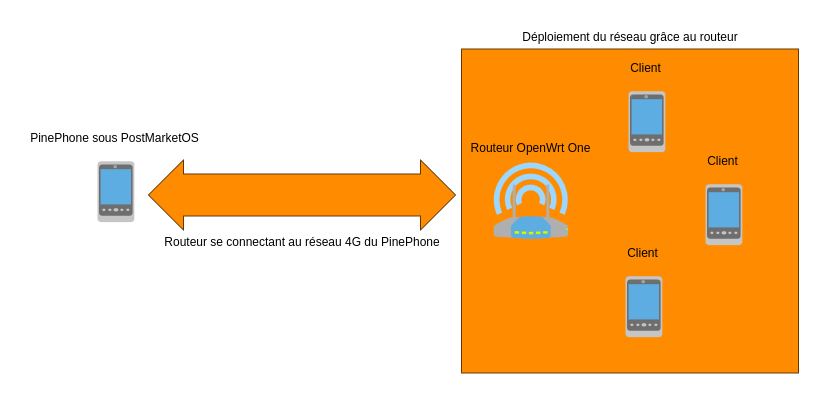

Nouvelle mission, configurer un routeur OpenWrt one avec un PinePhone pour partager le réseau cellulaire du PinePhone avec le routeur :

code sim : 7826

PostMarketOS :

id : user

mdp : 147147

Mobian :

id : mobian

mdp : 1234

Flash l'os OpenWrt stable sur le routeur OpenWrt One :

https://firmware-selector.openwrt.org/?version=25.12.2&target=mediatek%2Ffilogic&id=openwrt_one

Se brancher avec le câble RJ45 au routeur en mode NOR, puis aller à l’adresse http://192.168.1.1

Ensuite, flasher la nouvelle version et décocher "keep settings" pour le reset.

Après cela, attendre que l’opération se termine, puis redémarrer en mode NAND pour pouvoir le configurer.

| SCHEMA |

|---|

|

Jour 5: Vendredi 03 avril 2026¶

On a flash l'OS PostMarketOS sur le PinePhone dans la mémoire interne (eMMC) :

Pour flasher un OS, on utilise bmaptool ou balenaEtcher

Il faut d'abord flasher Jumpdrive sur une carte micro SD en utilisant :

pine64-pinephone.img.xz (version normale)

ou

pine64-pinephone-charging.img.xz (version si la batterie est complètement vide)

On insère ensuite cette carte micro SD dans le PinePhone.

On démarre le PinePhone sur Jumpdrive et on le branche au PC.

Pour flasher Mobian ou PostMarketOS sur le stockage eMMC du PinePhone :

Mobian pour le PinePhone classique : sunxi

Mobian pour le PinePhone Pro : rockchip

PostMarketOS pour le PinePhone classique : PINE64 PinePhone

PostMarketOS pour le PinePhone Pro : PINE64 PinePhone Pro

Une fois le flash terminé, on débranche et éteint le PinePhone, puis on retire la carte micro SD.

Il faut ensuite flasher Tow-Boot sur la carte micro SD (c'est le fichier avec "install" dans le nom qu'il faut flasher)

pour le PinePhone classique : pine64-pinephoneA64-xxxx.xx-xxx.tar.xz

pour le PinePhone Pro : pine64-pinephonePro-xxxx.xx-xxx.tar.xz

On insère à nouveau cette carte micro SD dans le PinePhone.

On démarre sur Tow-Boot avec le PinePhone pour l'installer dans la mémoire eMMC.

On retire enfin la carte micro SD du téléphone, on le rallume, et on a réussi à démarrer sur PostMarketOS.

Pour mettre le PinePhone en hotspot, il faut le faire graphiquement avec le bouton et activer les données cellulaires et aussi "Mobile Data On".

On récupère le hotspot avec le routeur qui prend le relai pour émettre le réseau.

En ssh sur le routeur openwrt one pour installer le relay bridge :apk updateapk add relayd luci-proto-relayreboot

On accède au menu Network, puis Wireless et on sélectionne Radio 0 pour scanner et rejoindre le réseau du PinePhone.

On est allé dans Network, puis Interfaces et on a édité l'interface Wi-Fi du PinePhone pour sélectionner le réseau sont dans l'onglet Device.

On a ajouté un pont relais depuis Network, puis Interfaces en sélectionnant Add et Relay bridge.

On a configuré le pont relais via l'option Relay between networks en associant l'interface du PinePhone et le réseau LAN.

On a créé un point d'accès depuis Network, puis Wireless et Radio 1 en cliquant sur Add.

On est revenu dans les paramètres du nouveau réseau Wi-Fi pour assigner le périphérique (Device) au réseau LAN.

Pour configurer le routeur, on s'est basé sur cette vidéo

Pour la mission du serveur, on a update le tableau et on a installé Debian 13 en fonction :| Partition | Taille | Point de montage |

| 1 | 512 Mo | /boot/efi (pour grub) |

| 2 | 2 Go | /boot |

| 3 | 2 Go | swap |

| 4 | 50 Go | / (Racine) |

| 5 | ~940 Go | Aucun |

| Paramètre | Valeur à mettre |

| Nom | efi |

| Utiliser comme | Partition système EFI |

| Indicateur d'amorçage | présent |

| Taille | 512 Mo |

| Paramètre | Valeur à mettre |

| Nom | boot |

| Utiliser comme | ext4 journalisé |

| Point de montage | /boot |

| Options de montage | defaults |

| Étiquette | aucune |

| Blocs réservés | 5% |

| Utilisation habituelle | standard |

| Indicateur d'amorçage | absent |

| Taille | 2 Go |

| Paramètre | Valeur à mettre |

| Nom | swap |

| Utiliser comme | espace d'échange (swap) |

| Point de montage | (aucun) |

| Options de montage | (aucun) |

| Étiquette | aucune |

| Indicateur d'amorçage | absent |

| Taille | 2 Go |

| Paramètre | Valeur à mettre |

| Nom | root |

| Utiliser comme | ext4 journalisé |

| Point de montage | / |

| Options de montage | défauts |

| Étiquette | aucune |

| Blocs réservés | 5% |

| Utilisation habituelle | standard |

| Indicateur d'amorçage | absent |

| Taille | 50 Go |

Pour le reste du disque (~940 Go) on n'a rien touché

On a aussi créé quatre comptes (pierre, alexander, yoan et nicolas).

On a transféré les clés SSH avec cette commande : ssh-copy-id idcompte@ipserveur

Jour 6: Lundi 06 avril 2026¶

Férié

Jour 7: Mardi 07 avril 2026¶

Cette fois-ci, on veut transférer la connexion du PinePhone au routeur via l'adaptateur USB > RJ45 :

Pour router les paquets entre les interfaces :

sudo sysctl -w net.ipv4.ip_forward=1

Pour le rendre permanent :

echo "net.ipv4.ip_forward=1" | sudo tee -a /etc/sysctl.conf

Pour activer la 4G :

sudo nmtui

Puis allez dans "Activer une connexion" et choisir la connexion mobile (4G).

Pour vérifier que la 4G fonctionne :

ping 8.8.8.8

Pour voir l'interface filaire :

ip a

Pour créer le partage de connexion avec l'interface filaire :

sudo nmcli connection add type ethernet ifname enx00e07c4601d6 ipv4.method shared con-name PartageUsb

Pour l'activer :

sudo nmcli connection up PartageUsb

Pour le routeur, on a ajusté la configuration :

le téléphone est désormais connecté au routeur via l'adaptateur.

Le routeur a été modifié pour s’adapter à ce changement :

dans Network > Interfaces on edit le repeat_wifi (le bridge) pour choisir dans Relay between networks "Lan" et "Wan".

Pour le projet avec le serveur :

Mise en place des utilisateurs dans le groupe sudo et désactivation du mode veille :

Passer en root :

su -

Désactiver le mode veille et masquer les services systemd responsables de la veille :

systemctl mask sleep.target suspend.target hibernate.target hybrid-sleep.target

Ajouter les utilisateurs au groupe sudo :

usermod -aG sudo yoan

usermod -aG sudo nicolas

usermod -aG sudo pierre

usermod -aG sudo alexander

Redémarrer pour appliquer les changements :

reboot

Mise en place du RAID 1 logiciel sur le serveur toutatis avec mdadm (sda = miroir de sdb) :

su -

apt install mdadm gdisk rsync

Copier la table de partitions de sdb vers sda, puis typer les partitions en Linux RAID :

sfdisk -d /dev/sdb | sfdisk /dev/sda

sgdisk --typecode=2:A19D880F-05FC-4D3B-A006-743F0F84911E /dev/sda

sgdisk --typecode=3:A19D880F-05FC-4D3B-A006-743F0F84911E /dev/sda

sgdisk --typecode=4:A19D880F-05FC-4D3B-A006-743F0F84911E /dev/sda

Créer les arrays RAID :

mdadm --create /dev/md2 --level=1 --raid-devices=2 --metadata=1.0 /dev/sda2 missing

mdadm --create /dev/md3 --level=1 --raid-devices=2 /dev/sda3 missing

mdadm --create /dev/md4 --level=1 --raid-devices=2 /dev/sda4 missing

Créer les systèmes de fichiers :

mkfs.ext4 /dev/md2

mkswap /dev/md3

mkfs.ext4 /dev/md4

Monter et copier le système :

mkdir -p /mnt/newroot

mount /dev/md4 /mnt/newroot

mkdir /mnt/newroot/boot

mount /dev/md2 /mnt/newroot/boot

rsync -aAXv --exclude={"/proc/","/sys/","/dev/","/run/","/mnt/","/tmp/"} / /mnt/newroot/

Récupérer les UUID des arrays et mettre à jour fstab :

blkid /dev/md2 /dev/md3 /dev/md4

vi /mnt/newroot/etc/fstab

Sauvegarder la config mdadm :

mdadm --detail --scan | tee /mnt/newroot/etc/mdadm/mdadm.conf

Chroot et mise à jour initramfs et installation de GRUB :

for dir in /dev /dev/pts /proc /sys /run; do mount --bind $dir /mnt/newroot$dir; done

mount /dev/sda1 /mnt/newroot/boot/efi

chroot /mnt/newroot

update-initramfs -u -k all

grub-install /dev/sda

update-grub

exit

reboot

Après reboot il faut ajouter sdb au RAID pour compléter le miroir :

mdadm /dev/md2 --add /dev/sda2

mdadm /dev/md3 --add /dev/sda3

mdadm /dev/md4 --add /dev/sda4

grub-install /dev/sdb

watch cat /proc/mdstat

Installation de Incus :

sudo apt install incus

Jour 8: Mercredi 08 avril 2026¶

Pour Incus :

installer Incus :

sudo apt install incus

Pour configurer et initialiser Incus

sudo incus admin init

Would you like to use clustering? (yes/no) [default=no]: no Do you want to configure a new storage pool? (yes/no) [default=yes]: yes Name of the new storage pool [default=default]: default Where should this storage pool store its data? [default=/var/lib/incus/storage-pools/default]: Would you like to create a new local network bridge? (yes/no) [default=yes]: yes What should the new bridge be called? [default=incusbr0]: What IPv4 address should be used? (CIDR subnet notation, “auto” or “none”) [default=auto]: auto What IPv6 address should be used? (CIDR subnet notation, “auto” or “none”) [default=auto]: auto We detected that you are running inside an unprivileged container. This means that unless you manually configured your host otherwise, you will not have enough uids and gids to allocate to your containers. Your container's own allocation can be reused to avoid the problem. Doing so makes your nested containers slightly less safe as they could in theory attack their parent container and gain more privileges than they otherwise would. Would you like to have your containers share their parent's allocation? (yes/no) [default=yes]: yes Would you like the server to be available over the network? (yes/no) [default=no]: no Would you like stale cached images to be updated automatically? (yes/no) [default=yes]: yes Would you like a YAML "init" preseed to be printed? (yes/no) [default=no]: no

Pour Redmine :

Pour créer le conteneur :

incus launch images:debian/13 redmine

pour ouvrir le terminal du conteneur :

incus exec redmine bash

pour installer docker :

apt update && apt install -y docker.io docker-compose

pour créer la config du docker pour Redmine et PostgreSQL :

mkdir -p /opt/redmine

cd /opt/redmine

vi docker-compose.yml

services:

db:

image: postgres:15

restart: always

environment:

POSTGRES_USER: redmine

POSTGRES_PASSWORD: "Fablab"

POSTGRES_DB: redmine_db

volumes:

- ./pgdata:/var/lib/postgresql/data

redmine:

image: redmine:latest

restart: always

ports:

- "80:3000"

environment:

REDMINE_DB_POSTGRES: db

REDMINE_DB_USERNAME: redmine

REDMINE_DB_PASSWORD: "Fablab"

REDMINE_DB_DATABASE: redmine_db

volumes:

- ./redmine_files:/usr/src/redmine/files

depends_on:

- db

pour lancer le docker :

docker compose up -d

exit

fixer l'ip :

incus config device override redmine eth0 ipv4.address=10.218.184.3

pour appliquer :

incus restart redmine

accessible à :

http://redmine.192.168.23.3.nip.io/

Pour NextCloud :

Installation de la vm nextcloud :

sudo incus launch images:debian/13 nextcloud --vm

On installe Apache, MariaDB, PHP et tous les modules requis par Nextcloud :

sudo apt install apache2 mariadb-server php libapache2-mod-php php-mysql php-xml php-mbstring php-zip php-gd php-curl php-intl php-bcmath php-gmp php-imagick php-redis unzip wget -y

On ouvre la console MariaDB pour créer la base de données et l'utilisateur :

sudo mysql -u root

CREATE DATABASE nextcloud;

USE nextcloud;

CREATE USER 'nc_user'@'localhost' IDENTIFIED BY 'MotDePasse';

GRANT ALL PRIVILEGES ON nextcloud.* TO 'nc_user'@'localhost';

FLUSH PRIVILEGES;

EXIT;

On télécharge la dernière version de nextcloud et on l'extrait et on la place dans le dossier d'Apache :

wget https://download.nextcloud.com/server/releases/latest.zip

unzip latest.zip

sudo mv nextcloud /var/www/html/

On donne au serveur web Apache les droits sur le dossier Nextcloud pour qu'il puisse le lire et le modifier :

sudo chown -R www-data:www-data /var/www/html/nextcloud/

sudo chmod -R 755 /var/www/html/nextcloud/

On créer un VirtualHost :

vi /etc/apache2/sites-enabled/nextcloud.conf

rm /etc/apache2/sites-enabled/000-default.conf

<VirtualHost *:80>

DocumentRoot /var/www/html/nextcloud/

<Directory /var/www/html/nextcloud/>

Require all granted

AllowOverride All

Options FollowSymLinks MultiViews

<IfModule mod_dav.c>

Dav off

</IfModule>

SetEnv HOME /var/www/html/nextcloud

SetEnv HTTP_HOME /var/www/html/nextcloud

</Directory>

<IfModule mod_rewrite.c>

RewriteEngine on

RewriteRule ^/\.well-known/carddav /remote.php/dav/ [R=301,L]

RewriteRule ^/\.well-known/caldav /remote.php/dav/ [R=301,L]

RewriteRule ^/\.well-known/webfinger /index.php/.well-known/webfinger [R=301,L]

RewriteRule ^/\.well-known/nodeinfo /index.php/.well-known/nodeinfo [R=301,L]

</IfModule>

ErrorLog ${APACHE_LOG_DIR}/nextcloud_error.log

CustomLog ${APACHE_LOG_DIR}/nextcloud_access.log combined

</VirtualHost>

On restart Apache :

sudo systemctl restart apache2

fixer l'ip :

incus config device override nextcloud eth0 ipv4.address=10.218.184.2

pour appliquer :

incus restart nextcloud

accessible à :

http://nextcloud.192.168.23.3.nip.io/

Pour site web Laravel :

pour créer la VM sous debian13

sudo incus launch images:debian/13 laravel-web --vm

fixer l'ip :

sudo incus config device override laravel-web eth0 ipv4.address=10.218.184.5

pour appliquer :

sudo incus restart laravel-web

pour acceder au shell de la VM :

sudo incus shell laravel-web

installer les fonctionnalités pour Laravel :

apt update && apt upgrade -y

apt install -y composer git unzip curl \

php-xml php-mbstring php-curl php-zip php-bcmath php-intl

pour config le serveur :

vi /etc/nginx/sites-available/laravel

source

server {

listen 80;

listen [::]:80;

server_name example.com;

root /srv/example.com/public;

add_header X-Frame-Options "SAMEORIGIN";

add_header X-Content-Type-Options "nosniff";

index index.php;

charset utf-8;

location / {

try_files $uri $uri/ /index.php?$query_string;

}

location = /favicon.ico { access_log off; log_not_found off; }

location = /robots.txt { access_log off; log_not_found off; }

error_page 404 /index.php;

location ~ ^/index\.php(/|$) {

fastcgi_pass unix:/var/run/php/php8.2-fpm.sock;

fastcgi_param SCRIPT_FILENAME $realpath_root$fastcgi_script_name;

include fastcgi_params;

fastcgi_hide_header X-Powered-By;

}

location ~ /\.(?!well-known).* {

deny all;

}

}

pour activer le site et redémarrer Nginx :

ln -s /etc/nginx/sites-available/laravel /etc/nginx/sites-enabled/

systemctl restart nginx

accessible à :

http://laravel.192.168.23.3.nip.io/

Pour Git Forgejo :

Installation de la vm git :

sudo incus launch images:debian/13 git --vm

Installer les paquets requis Git et SQLite3 :

sudo apt install git git-lfs wget tar sqlite3 -y

Pour isoler et sécuriser le service créer un utilisateur système dédié nommé forgejo :

sudo adduser \

--system \

--shell /bin/bash \

--gecos 'Forgejo Git Service' \

--group \

--disabled-password \

--home /var/lib/forgejo \

forgejo

Récupérer la version de Forgejo puis placer le binaire exécutable dans le dossier système approprié :

wget -O forgejo https://codeberg.org/forgejo/forgejo/releases/download/v14.0.3/forgejo-14.0.3-linux-amd64

sudo chmod +x forgejo

sudo mv forgejo /usr/local/bin/forgejo

Créer les dossiers où Forgejo stockera ses dépôts, ses configurations et ses logs, et donne la propriété à l'utilisateur forgejo :

sudo mkdir -p /var/lib/forgejo/{custom,data,log}

sudo chown -R forgejo:forgejo /var/lib/forgejo/

sudo chmod -R 750 /var/lib/forgejo/

sudo mkdir /etc/forgejo

sudo chown root:forgejo /etc/forgejo

sudo chmod 770 /etc/forgejo

Pour automatiser le démarrage de Forgejo :

sudo vi /etc/systemd/system/forgejo.service

[Unit] Description=Forgejo (Self-Hosted Git Service) After=network.target [Service] RestartSec=2s Type=simple User=forgejo Group=forgejo WorkingDirectory=/var/lib/forgejo ExecStart=/usr/local/bin/forgejo web --config /etc/forgejo/app.ini Restart=always Environment=USER=forgejo HOME=/var/lib/forgejo GITEA_WORK_DIR=/var/lib/forgejo [Install] WantedBy=multi-user.target

Rechargez systemd puis activer et démarrer le service Forgejo :

sudo systemctl daemon-reload

sudo systemctl enable --now forgejo

sudo systemctl status forgejo

fixer l'ip :

sudo incus config device override git eth0 ipv4.address=10.218.184.4

pour appliquer :

sudo incus restart git

accessible à :

http://git.192.168.23.3.nip.io/

Pour Vaultwarden :

sudo incus launch images:debian/13 vaultwarden

sudo incus shell vaultwarden

apt update && apt install -y docker.io docker-compose

mkdir -p /opt/vaultwarden

cd /opt/vaultwarden

vi docker-compose.yml

services:

vaultwarden:

image: vaultwarden/server:latest

container_name: vaultwarden

restart: always

environment:

- WEBSOCKET_ENABLED=true

- ADMIN_TOKEN="Fablab"

ports:

- "80:80"

volumes:

- ./vw-data:/data

docker compose up -d

fixer l'ip :

sudo incus config device override vaultwarden eth0 ipv4.address=10.218.184.6

pour appliquer :

sudo incus restart vaultwarden

accessible à :

http://vaultwarden.192.168.23.3.nip.io/

Pour Caddy :

apt install caddy

sudo vi /etc/caddy/Caddyfile

http://nextcloud.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.2:80

}

http://redmine.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.3:80

}

http://git.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.4:3000

}

http://laravel.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.5:80

}

http://vaultwarden.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.6:80

}

sudo systemctl restart caddy

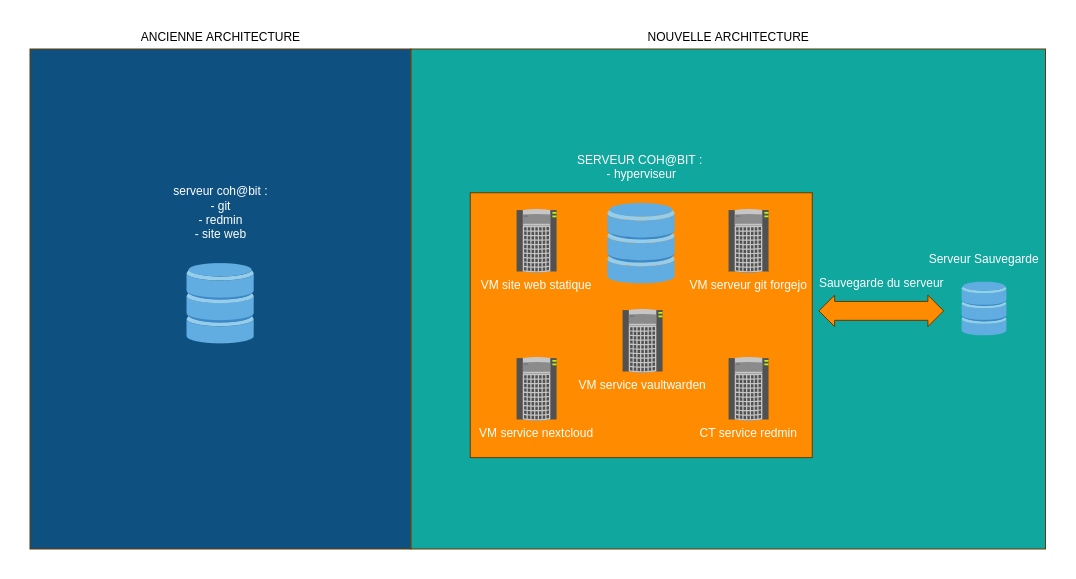

On a aussi modifié le tableau et le schema pour ajouté vaultwarden :

| Service | RAM minimum | RAM recommandée | CPU minimum | CPU recommandé |

| Apache | 512 MB | 1–4 GB | 1 core | 2+ cores |

| Nginx | 512 MB | 1 GB | 1 core | 2+ cores |

| Laravel | 1 GB | 2+ GB | 1 core | 2+ cores |

| Redmine | 512 MB | 1–2 GB | 1 core | 2 cores |

| Forgejo | 512 MB | 2 GB | 1 core | 2+ cores |

| Nextcloud | 512 MB | 2 GB | 1 core | 2 cores |

| vaultwarden | 512 MB | 1 GB | 1 core | 2 cores |

| total | 4 GB | 10-14+ GB | 7 cores | 14+ cores |

| SCHEMA |

|---|

|

Jour 9: Jeudi 09 avril 2026¶

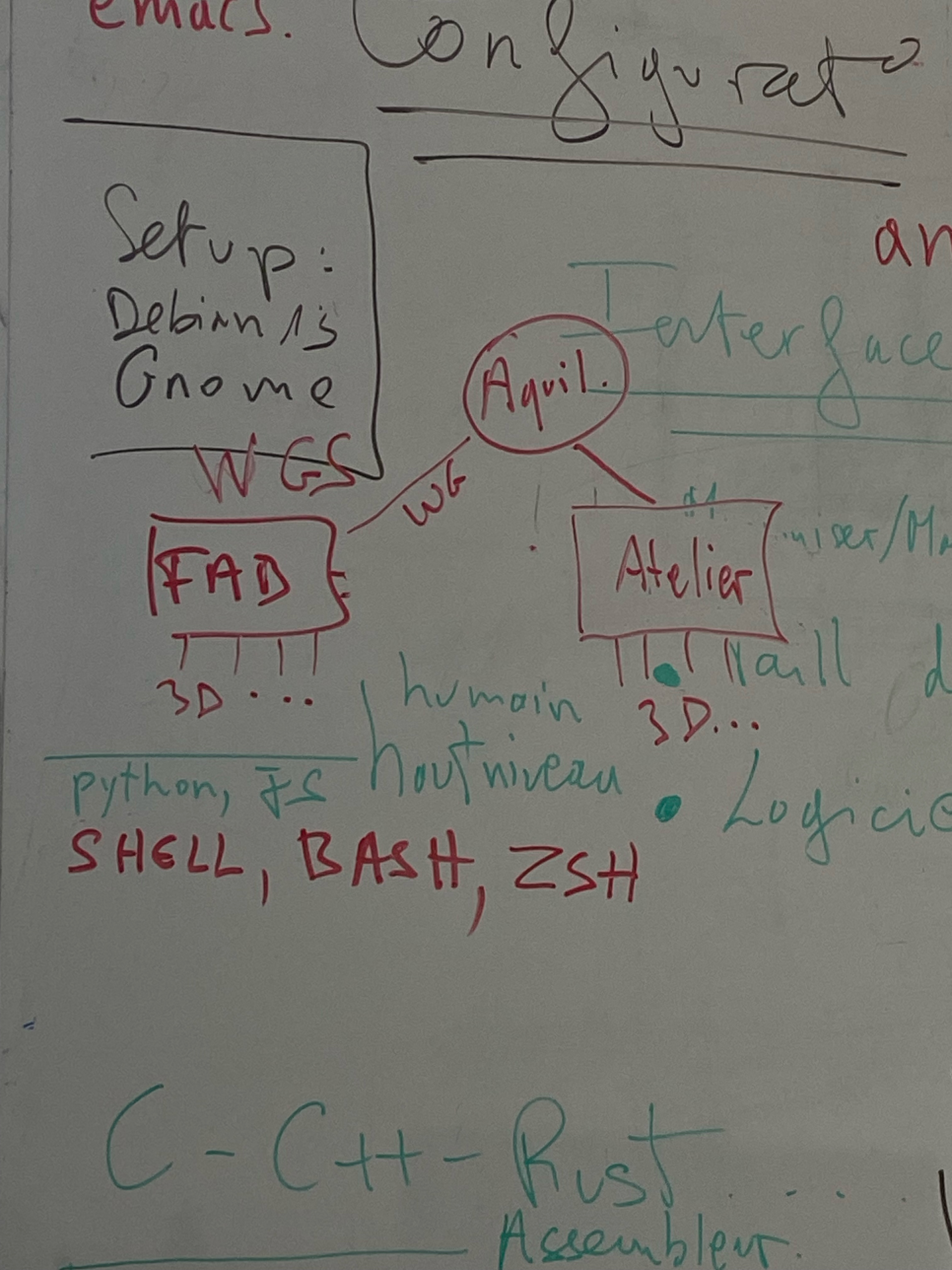

Pour projet Routeur PinePhone WireGuard :

https://www.reddit.com/r/WireGuard/comments/18pee5i/wireguard_working_as_server_and_client_of_another/

| Photo schema |

|---|

|

Pour le projet serveur, on a maintenant accès en SSH et on fait la migration vers le nouveau serveur dans les VMs/conteneurs d'Incus.

Le travail est réparti entre le jeudi 9 et le vendredi 10, mais nous l’avons écrit dans la partie du vendredi 10.

Jour 10: Vendredi 10 avril 2026¶

Migration du site en Laravel sur le serveur incus :

sur le serveur cohabit :

tar -czvf ~/migration-complete.tar.gz \

/etc/apache2 \

/var/www/html

sur le serveur toutatis :

scp -P 55555 nicolas@projets.cohabit.fr:~/migration-complete.tar.gz ~/

scp -P 55555 nicolas@projets.cohabit.fr:/opt/laravel/laravel ~/

sudo incus file push -r ~/migration-complete.tar.gz laravel-web/

sudo incus file push -r ~/laravel laravel-web/

sudo incus shell laravel-web

Sur le conteneur laravel-web :

apt update

apt install -y apache2 postgresql postgresql-contrib git unzip curl php8.4 libapache2-mod-php8.4 php8.4-cli php8.4-pgsql php8.4-ldap php8.4-readline php8.4-opcache

mkdir /temp-web

tar -xzvf /migration-complete.tar.gz -C /temp-web

cp -r /temp-web/etc /.

cp -r /temp-web/var /.

mkdir /opt/laravel

cp -r /laravel /opt/laravel/.

a2enmod rewrite ssl proxy proxy_http headers

chown -R www-data:www-data /var/www/html

chown -R www-data:www-data /opt/laravel/laravel

chmod -R 775 /opt/laravel/laravel/storage

chmod -R 775 /opt/laravel/laravel/bootstrap/cache

systemctl restart apache2

mais j'ai cette erreur :

root@laravel-web:~# systemctl restart apache2

Job for apache2.service failed because the control process exited with error code.

See "systemctl status apache2.service" and "journalctl -xeu apache2.service" for details.

donc pour voir en détaille ce qui pose problème :

root@laravel-web:~# apache2ctl configtest

apache2: Syntax error on line 145 of /etc/apache2/apache2.conf: Syntax error on line 1 of /etc/apache2/mods-enabled/passenger.load: Cannot load /usr/lib/apache2/modules/mod_passenger.so into server: /usr/lib/apache2/modules/mod_passenger.so: cannot open shared object file: No such file or directory

Pour dire à Apache d'arrêter d'essayer de charger le module :

a2dismod passenger

mais :

apache2: Syntax error on line 145 of /etc/apache2/apache2.conf: Syntax error on line 3 of /etc/apache2/mods-enabled/php8.2.load: Cannot load /usr/lib/apache2/modules/libphp8.2.so into server: /usr/lib/apache2/modules/libphp8.2.so: cannot open shared object file: No such file or directory

donc on désactive le module PHP8.2 :

a2dismod php8.2

puis on active le bon module (PHP8.4) :

a2enmod php8.4

mais :

root@laravel-web:~# apache2ctl configtest

AH00526: Syntax error on line 17 of /etc/apache2/sites-enabled/forgejo-ssl.conf:

SSLCertificateFile: file '/cert/live/git.cohabit.fr/fullchain.pem' does not exist or is empty

il bloque car il y a un certificat SSL introuvable (de la conf de forgejo) donc :

a2dissite forgejo-ssl.conf

mais :

root@laravel-web:~# apache2ctl configtest

AH00526: Syntax error on line 9 of /etc/apache2/sites-enabled/laravel_accueil.conf:

SSLCertificateFile: file '/cert/live/cohabit.fr/fullchain.pem' does not exist or is empty

dans le fichier de configuration du site, il y a encore des traces de certificats ssl donc :

vi /etc/apache2/sites-enabled/laravel_accueil.conf

et on a mis en commentaire la partie pour les ssl :

# SSLCertificateFile /cert/live/cohabit.fr/fullchain.pem

# SSLCertificateKeyFile /cert/live/cohabit.fr/key.pem

...

# SSLCertificateFile /cert/live/www.cohabit.fr/fullchain.pem

# SSLCertificateKeyFile /cert/live/www.cohabit.fr/key.pem

et on a commenté la partie non commentée pour mettre cette config à la place (temporairement) dans le master.conf :

<VirtualHost *:80>

DocumentRoot /opt/laravel/laravel/public/

<Directory /opt/laravel/laravel/public/>

AllowOverride All

Require all granted

</Directory>

ErrorLog ${APACHE_LOG_DIR}/laravel_accueil_error.log

CustomLog ${APACHE_LOG_DIR}/laravel_accueil_access.log combined

</VirtualHost>

systemctl reload apache2

mais :

root@laravel-web:~# apache2ctl configtest

AH00526: Syntax error on line 21 of /etc/apache2/sites-enabled/redmine-ssl.conf:

Invalid command 'RailsEnv', perhaps misspelled or defined by a module not included in the server configuration

meme chose que fogejo mais cette fois avec redmine donc :

a2dissite redmine-ssl.conf

mais sur la page web il y a :

Code d’erreur : SSL_ERROR_INTERNAL_ERROR_ALERT

Pour le moment, on va juste dire à caddy de ne pas demander de certificat, donc on ajoute (tls internal) sur le serveur toutatis donc :

exit

sudo vi /etc/caddy/Caddyfile

laravel.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.5:80

}

sudo systemctl restart caddy

mais sur la page du site :

La page n’est pas redirigée correctement

Firefox a détecté que le serveur redirige la demande pour cette adresse d’une manière qui n’aboutira pas.

La cause de ce problème peut être la désactivation ou le refus des cookies.

Par defaut laravel ne fait pas confiance à l'adresse ip de caddy donc pour qu'elle accepte toutes les requêtes du réseau local (Caddy) :

vi /opt/laravel/laravel/app/Http/Middleware/TrustProxies.php

on modifie la ligne protected $proxies; pour mettre cela :

protected $proxies = '*';

cd /opt/laravel/laravel

php artisan optimize:clear

mais sur la page web "could not find driver" :

apt install -y php-pgsql

systemctl restart apache2

mais :

SQLSTATE[08006] [7] connection to server at "127.0.0.1", port 5432 failed: Connection refused Is the server running on that host and accepting TCP/IP connections?

donc :

apt install -y postgresql postgresql-contrib

sudo -u postgres psql

CREATE USER laravel WITH PASSWORD 'p5U!aUe8!';

CREATE DATABASE laravel OWNER laravel;

\q

maintenant il faut importer les données de l'ancien serveur dans la nouvelle base :

sur le serveur cohabit :

sudo -u postgres pg_dump laravel > /tmp/sauvegarde_laravel.sql

sur le serveur toutatis :

scp -P 55555 nicolas@projet.cohabit.fr:/tmp/sauvegarde_laravel.sql ~/.

incus file push ~/sauvegarde_laravel.sql laravel-web/

puis sur le conteneur laravel-web :

sudo -u postgres psql laravel -f /sauvegarde_laravel.sql

ou

sur le serveur cohabit :

echo '127.0.0.1:5432:laravel:laravel:p5U!aUe8!' > ~/.pgpass chmod 600 ~/.pgpass pg_dump -U laravel -h 127.0.0.1 -p 5432 -Fc --file=/tmp/laravel_db.dump laravel

sur le serveur toutatis :

scp -P 55555 nicolas@projet.cohabit.fr:/laravel_db.dump ~/.

incus file push ~/laravel_db.dump laravel-web/

puis sur le conteneur laravel-web :

pg_restore -U laravel -h localhost -d laravel --verbose --clean /laravel_db.dump

et c'est bon le site fonctionne.

Jour 11: Lundi 13 avril 2026¶

Jour 12: Mardi 14 avril 2026¶

Jour 13: Mercredi 15 avril 2026¶

Jour 14: Jeudi 16 avril 2026¶

Jour 15: Vendredi 17 avril 2026¶

Jour 16: Lundi 20 avril 2026¶

On a agrandi le / car c'est là où on stocke tout et on avait 900 Go sans partition

| Partition | Taille | Point de montage | Rôle |

| 1 | 512 Mo | /boot/efi | Pour le démarrer en UEFI |

| 2 | 2 Go | /boot | Pour le boot Debian |

| 3 | 2 Go | swap | Sécurité si la RAM sature |

| 4 | ~995 Go | / (Racine) | La Debian de l'hyperviseur, Incus et logs |

1. Voir l'espace disque actuel

df -h /

1. Voir la structure des disques et du RAID

lsblk -f

1. Voir les partitions exactes

sudo fdisk -l /dev/sda

sudo fdisk -l /dev/sdb

2. Agrandir la partition sda4

sudo fdisk /dev/sda

Dans fdisk, taper dans l'ordre :

d # Supprimer une partition

4 # Numéro de partition 4

n # Créer une nouvelle partition

4 # Numéro de partition 4

8814592 # Secteur de début

# Entrée vide = utiliser tout l'espace restant

N # Ne PAS supprimer la signature linux_raid_member

t # Changer le type

4 # Partition 4

linux-raid # Type RAID Linux

w # Écrire et quitter

3. Agrandir la partition sdb4

sudo fdisk /dev/sdb

Dans fdisk, taper dans l'ordre :

d # Supprimer une partition

4 # Numéro de partition 4

n # Créer une nouvelle partition

4 # Numéro de partition 4

8814592 # Secteur de début

# Entrée vide = utiliser tout l'espace restant

N # Ne PAS supprimer la signature linux_raid_member

t # Changer le type

4 # Partition 4

linux-raid # Type RAID Linux

w # Écrire et quitter

4. Vérifier que les deux partitions sont bien en "RAID Linux"

sudo fdisk -l /dev/sda | grep sda4

sudo fdisk -l /dev/sdb | grep sdb4

Les deux doivent afficher "RAID Linux" et ~927 Go

5. Agrandir le volume RAID mdadm

sudo mdadm --grow /dev/md4 --size=max

6. Surveiller la resynchronisation

watch cat /proc/mdstat

La synchronisation est terminée quand on voit :

md4 : active raid1 sda4[0] sdb4[2]

972320768 blocks super 1.2 [2/2] [UU]

7. Étendre le système de fichiers ext4

sudo resize2fs /dev/md4

8. Vérifier le résultat final

df -h /

____________________________________________________________________________________________________________________

Agrandir l'espace de la vm git

sudo incus config device override git root size=100GiB

Entré dans la VM git

sudo incus exec git -- bash

Installer gdisk dans la VM

apt install -y gdisk

Agrandir la partition

sgdisk -e /dev/sda

exit

Redémarrer la VM

sudo incus restart git

Agrandir le filesystem

sudo incus exec git -- bash

resize2fs /dev/sda2

Vérifier

df -h /

____________________________________________________________________________________________________________________

Transféré les données de l'ancien git vers le nouveau

Depuis l'ancien serveur

sudo zip -r ~/forgejo-repos.zip /var/lib/forgejo/data

Depuis le nouveau serveur

scp -P 55555 yoan@projets.cohabit.fr:~/forgejo-repos.zip ~/

sudo incus file push ~/forgejo-repos.zip git/root/forgejo-repos.zip

sudo incus exec git -- bash

Dans la VM git

Ne pas remplacer les fichiers du dossier indexés et queues

unzip /root/forgejo-repos.zip -d /

chown -R forgejo:forgejo /var/lib/forgejo/

systemctl restart forgejo

systemctl status forgejo

Pour sauvegarde :

https://www.perplexity.ai/search/j-ai-un-serveur-incus-et-j-ai-s9CK1LPMTfWnGEQLP74P6A

Jour 17: Mardi 21 avril 2026¶

Nous avons continué à faire le transférer entre les deux serveurs et nous avons changé/Maj la partie de laravel-web (voir vendredi 10 avril 2026)

et nous avons aussi fait Zotero :

sudo incus launch images:debian/13 zotero

sudo incus shell zotero

apt update && apt install -y docker.io docker-compose

docker run -d \

--name=zotero \

-e PUID=1000 \

-e PGID=1000 \

-e TZ=Etc/UTC \

-p 3000:3000 \

-p 3001:3001 \

-v /path/to/config:/config \

--shm-size="1gb" \

--restart unless-stopped \

lscr.io/linuxserver/zotero:latest

fixer l'ip :

sudo incus config device override zotero eth0 ipv4.address=10.218.184.7

Pour appliquer :

sudo incus restart zotero

Rajouter Zotero dans caddy

sudo vi /etc/caddy/Caddyfile

zotero.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.7:3000

}

sudo systemctl restart caddy

Accéder à Zotero

http://zotero.192.168.23.3.nip.io

Redmine et en cours.

Jour 18: Mercredi 22 avril 2026¶

| Composant | Serveur cohabit | Serveur laravel-web | Commande pour vérifier |

| Apache2 | 2.4.66 | 2.4.66 | apachectl -v |

| PHP | 8.4.15 | 8.4.16 | php -v |

| PostgreSQL | 17.4 | 17.9 | psql --version |

| Laravel | 9.52.10 | 9.52.10 | php artisan --version |

| Modules PHP (php -m) | [PHP Modules] calendar Core ctype date exif FFI fileinfo filter ftp gettext hash iconv json ldap libxml openssl pcntl pcre PDO pdo_pgsql pgsql Phar posix random readline Reflection session shmop sockets sodium SPL standard sysvmsg sysvsem sysvshm tokenizer Zend OPcache zlib [Zend Modules] Zend OPcache | [PHP Modules] calendar Core ctype date exif FFI fileinfo filter ftp gettext hash iconv json ldap libxml openssl pcntl pcre PDO pdo_pgsql pgsql Phar posix random readline Reflection session shmop sockets sodium SPL standard sysvmsg sysvsem sysvshm tokenizer Zend OPcache zlib [Zend Modules] Zend OPcache | php -m |

Jour 19: Jeudi 23 avril 2026¶

https://github.com/orgs/suitenumerique/repositories

Nous avons fait des recherches sur LaSuiteNumérique pour peut-être l'utiliser et du coup le mettre en place à la place de Nextcloud et aussi utiliser d'autre fonctionnalité.

Et pour Redmine, nous avons essayé de passer directement sur une version récente, mais on n'a pas réussi donc demain, on va juste essayer de l'importer sans changer de version.

Jour 20: Vendredi 24 avril 2026¶

Migration de Redmine sur le serveur incus (en gardant la même version)

Initialisation de la vm :

sudo incus init images:debian/13 redmine --vm

sudo incus config device override redmine root size=100GiB

sudo incus config device override redmine eth0 ipv4.address=10.218.184.3

sudo incus start redmine

sudo incus file push -r ~/redmine_db.dump redmine2/root/

sudo incus file push -r ~/migration-opt-redmine.tar.gz redmine2/root/

sudo incus shell redmine

Installation des dépendances système

apt update && apt upgrade -y

apt install -y ruby ruby-dev ruby-psych postgresql postgresql-contrib \

postgresql-server-dev-all libxslt1-dev libyaml-dev libxml2-dev \

libpq-dev libcurl4-openssl-dev zlib1g-dev apache2 apache2-dev \

gcc g++ make patch imagemagick git

Création de la base de données PostgreSQL

su - postgres

createuser redmine

createdb redmine -O redmine

set +H

psql -c "ALTER USER redmine WITH PASSWORD 'MDP';"

set -H

exit

Configuration de pg_hba.conf

vi /etc/postgresql/17/main/pg_hba.conf

local all all md5

host all all 127.0.0.1/32 md5

host all all ::1/128 md5

systemctl restart postgresql

Restauration de la base de donnée

cp /root/redmine_db.dump /tmp/redmine_db.dump

su - postgres

dropdb redmine

createdb redmine -O redmine

pg_restore --no-owner -x -d redmine /tmp/redmine_db.dump

exit

Donner les droits à l'utilisateur redmine :

su - postgres

psql -d redmine

sql

GRANT ALL ON SCHEMA public TO redmine;

GRANT ALL PRIVILEGES ON ALL TABLES IN SCHEMA public TO redmine;

GRANT ALL PRIVILEGES ON ALL SEQUENCES IN SCHEMA public TO redmine;

ALTER DEFAULT PRIVILEGES IN SCHEMA public GRANT ALL ON TABLES TO redmine;

ALTER DEFAULT PRIVILEGES IN SCHEMA public GRANT ALL ON SEQUENCES TO redmine;

ALTER DATABASE redmine OWNER TO redmine;

\q

exit

Déploiement des fichiers Redmine

mkdir /var/www/redmine

tar -xzvf migration-opt-redmine.tar.gz -C /

Installation des gems Ruby

cd /opt/redmine/redmine-5.0.5/

vi Gemfile

Avant : ruby ">= 2.5.0", "< 3.2.0"

Après : ruby ">= 2.5.0", "< 3.4.0"

Avant : gem "pg", "~> 1.2.2", :platforms => [:mri, :mingw, :x64_mingw]

Après : gem "pg", "~> 1.5.0", :platforms => [:mri, :mingw, :x64_mingw]

gem install bundler

bundle config set --local without 'development test mysql sqlite'

bundle update pg

bundle install

Initialisation de Redmine

bundle exec rake generate_secret_token RAILS_ENV=production

bundle exec rake db:migrate RAILS_ENV=production

bundle exec rake redmine:plugins:migrate RAILS_ENV=production

Permissions des fichiers

chown -R www-data:www-data /opt/redmine/redmine-5.0.5

chmod -R 755 /opt/redmine/redmine-5.0.5

chmod -R 777 /opt/redmine/redmine-5.0.5/tmp \

/opt/redmine/redmine-5.0.5/log \

/opt/redmine/redmine-5.0.5/files \

/opt/redmine/redmine-5.0.5/public/plugin_assets

Installation de Passenger via APT

apt install -y dirmngr gnupg apt-transport-https ca-certificates

curl https://oss-binaries.phusionpassenger.com/auto-software-signing-gpg-key.txt | \

gpg --dearmor | tee /etc/apt/trusted.gpg.d/phusion.gpg > /dev/null

echo "deb https://oss-binaries.phusionpassenger.com/apt/passenger bookworm main" > \

/etc/apt/sources.list.d/passenger.list

apt update

apt install -y libapache2-mod-passenger

a2enmod passenger

systemctl restart apache2

Configuration Apache

vi /etc/apache2/sites-enabled/redmine.conf

<VirtualHost *:80>

DocumentRoot /opt/redmine/redmine-5.0.5/public

PassengerRuby /usr/bin/ruby3.3

<Directory /opt/redmine/redmine-5.0.5/public>

Options FollowSymLinks

AllowOverride All

Require all granted

</Directory>

ErrorLog ${APACHE_LOG_DIR}/redmine_error.log

CustomLog ${APACHE_LOG_DIR}/redmine_access.log combined

</VirtualHost>

a2ensite redmine

rm /etc/apache2/sites-enabled/default-ssl.conf

rm /etc/apache2/sites-enabled/000-default.conf

systemctl restart apache2

exit

Configuration de caddy

sudo vi /etc/caddy/Caddyfile

redmine.192.168.23.3.nip.io {

tls internal

reverse_proxy 10.218.184.3:80

}

systemctl restart caddy

Accéder au site :

https://redmine.192.168.23.3.nip.io/

Jour 21: Lundi 27 avril 2026¶

Nous avons upgradé redmine 5.0.5 vers redmine 5.1.12 et on a aussi un autre conteneur redmine pour tester la version 6.1.2, mais elle n'est pas totalement compatible.

On a deux conteneurs incus que l'on a renommé ainsi :

redmine-6-1-2

redmine-5-1-12

et on a créé des snapshots pour chacune :

pour redmine-6-1-2 elle s'appelle redmine-6-1-2

et pour redmine-5-1-12 elles s'appellent redmine-5-1-12 et aussi redmine-5-0-5

Pour le conteneur de redmine-6-1-2, on a donc mis à jour de 5.0.5 vers 6.1.2, mais les thèmes ne sont pas compatibles (icônes devenues noires et énormes), donc on les a retirés pour laisser le thème par défaut et pour les plugins, on a téléchargé des versions compatibles.

Pour le conteneur de redmine-5-1-12, on a donc mis à jour de 5.0.5 vers 5.1.12 (aucun problème de compatibilité) mais on a aussi laissé dessus la version 5.0.5 avec sa snapshot au cas de problème.

Upgrade redmine 5.0.5 vers 5.1.12

Télécharger Redmine

cd /opt/redmine

wget https://www.redmine.org/releases/redmine-5.1.12.tar.gz

tar -xzf redmine-5.1.12.tar.gz

Config base de données

cp redmine-5.0.5/config/database.yml redmine-5.1.12/config/

Config générale

cp redmine-5.0.5/config/configuration.yml redmine-5.1.12/config/

Fichiers des projets

cp -r redmine-5.0.5/files/* redmine-5.1.12/files/

Plugins

cp -r redmine-5.0.5/plugins/* redmine-5.1.12/plugins/

Thèmes

cp -r redmine-5.0.5/public/themes/* redmine-5.1.12/public/themes/

Modifier L'utilisateur pour le nouveau Redmine

sudo -u postgres psql -d redmine

Changer le propriétaire de toutes les tables

DO $$

DECLARE obj RECORD;

BEGIN

FOR obj IN SELECT tablename FROM pg_tables WHERE schemaname = 'public' LOOP

EXECUTE 'ALTER TABLE public.' || quote_ident(obj.tablename) || ' OWNER TO redmine';

END LOOP;

END $$;

Changer le propriétaire de toutes les séquences

DO $$

DECLARE obj RECORD;

BEGIN

FOR obj IN SELECT sequence_name FROM information_schema.sequences WHERE sequence_schema = 'public' LOOP

EXECUTE 'ALTER SEQUENCE public.' || quote_ident(obj.sequence_name) || ' OWNER TO redmine';

END LOOP;

END $$;

GRANT ALL ON SCHEMA public TO redmine;

\q

Installer Redmine

cd /opt/redmine/redmine-5.1.12

bundle config set --local without 'development test'

bundle install

bundle exec rake db:migrate RAILS_ENV=production

Régénérer le token secret

bundle exec rake generate_secret_token RAILS_ENV=production

Migration des plugins

bundle exec rake redmine:plugins:migrate RAILS_ENV=production

Recompiler les assets

bundle exec rake assets:clobber RAILS_ENV=production

bundle exec rake assets:precompile RAILS_ENV=production

Appliquer les permissions

chown -R www-data:www-data /opt/redmine/redmine-5.1.12

vi /etc/apache2/sites-enable/redmine.conf

<VirtualHost *:80>

DocumentRoot /opt/redmine/redmine-5.1.12/public

PassengerRuby /usr/bin/ruby3.3

<Directory /opt/redmine/redmine-5.1.12/public>

Options FollowSymLinks

AllowOverride All

Require all granted

</Directory>

ErrorLog ${APACHE_LOG_DIR}/redmine_error.log

CustomLog ${APACHE_LOG_DIR}/redmine_access.log combined

</VirtualHost>

Redémarrer le service

systemctl restart apache2

Upgrade redmine 5.0.5 vers 6.1.2

C'est à peu près pareil qu'au-dessus, mais à la place d'écrire 5.1.12, c'est 6.1.2, mais il y a un problème avec cette version, car les thèmes et les plugins ne sont pas compatibles donc pour ces parties-là, nous avons fait :

Pour les thèmes :

Nous avons déplacé le dossier /public/themes/ à la racine du dossier Redmine parce que dans les versions 6.X, c'est comme ça donc /themes/ et on a regardé le résultat, mais les icônes sont surdimensionnées et toute noires donc comme nous ne savons pas régler cela, on a laissé le thème par défaut de Redmine.

Pour les plugins :

On a pu trouver les dernières versions compatibles pour les plugins redmine_wiki_extensions et redmine_agile mais pas pour redmine_embedded_video donc on l'a laissé, mais il ne fonctionne pas (nous avons l'impression que les plugins ne change rien au Redmine comme s'ils n'étaient pas chargés alors qu'ils le sont bien).

Migration des plugins

bundle exec rake redmine:plugins:migrate RAILS_ENV=production

Nous avons aussi envoyé un message à Alexander et Pierre :

Voici une mise à jour sur l'avancement de nos déploiements. Nous avons mis en place Vaultwarden et Zotero en conteneurs, alors que Git-Forgejo, Nextcloud, Redmine et Laravel sont installés sur des VMs. Si vous préférez qu'un de ces services soit sur une VM plutôt qu'un conteneur ou inversement, dites-le-nous et nous ferons la modification. Nous avions également quelques questions pour la suite : Pour Laravel, vous pouvez consulter la liste des services installés sur le conteneur et comparer leurs versions avec celles du serveur Cohabit actuel sur ce lien : https://projets.cohabit.fr/redmine/projects/accueil/wiki/Nicolas_Schmauch_2#Jour-18-Mercredi-22-avril-2026. Souhaitez-vous que nous procédions à leur mise à jour ? Pour Redmine, nous avons déjà installé trois versions différentes pour faire des tests. Il ne nous reste plus qu'à choisir laquelle conserver. Laquelle préférez-vous garder ? - La version actuelle du serveur Cohabit (5.0.5). - Une version mise à jour compatible (5.1.12). - Une version plus récente, mais moins compatible (6.1.2). Vous trouverez plus de détails sur ces versions de Redmine ici : https://projets.cohabit.fr/redmine/projects/accueil/wiki/Nicolas_Schmauch_2#Jour-21-Lundi-27-avril-2026. Enfin, nous avons découvert Watchtower, un outil qui permet de maintenir automatiquement à jour les conteneurs Docker. Le projet officiel ayant été archivé (https://github.com/containrrr/watchtower), nous avons trouvé un fork qui est toujours maintenu (https://github.com/nicholas-fedor/watchtower/ https://watchtower.nickfedor.com/v1.16.1/). Si cette automatisation vous intéresse, nous pouvons vous la mettre en place.

Jour 22: Mardi 28 avril 2026¶

On nous a répondu :

Salut, automatiser la montée de version je ne suis pas sûr mais à voir pourquoi pas, en revanche surveiller et prévenir/alerter ça oui à 100% à minima. Pour redmine le meilleur conseil que j'ai à donner c'est de ne jamais faire la montée de version sur le serveur actuel ou vous allez avoir des envies bien sombres derrière. La version pleinement compatible semble déjà un bon compromis pour le moment, à la limite si vous trouvez d'autres thèmes sympa on peut regarder pour les mettre ou modifier aux couleurs du fablab En revanche je vais faire l'embetant, je pourrais avoir en plus un petit graph de l'infra vm/kube avec les différents points d'entrée ? (Ou plus tard si vous voulez, si vous comptez encore modifier des choses après ces premiers tests :) )

Donc, nous avons demandé :

Nous pensons à automatiser la montée de version, surtout pour Vaultwarden, car souvent les applications et extensions Bitwarden refusent la connexion à un serveur Vaultwarden qui n'est pas à jour. Donc pourquoi pas mettre watchtower juste pour vaultwarden.

Il nous a dit :

Ça fait des Snapshot automatiquement avant la montée de version ? Si oui ça serait parfait du coup et possible de l'appliquer aux autres

Comme Watchtower ne permet pas de faire de snapshot, nous avons donc convenu de faire un script :

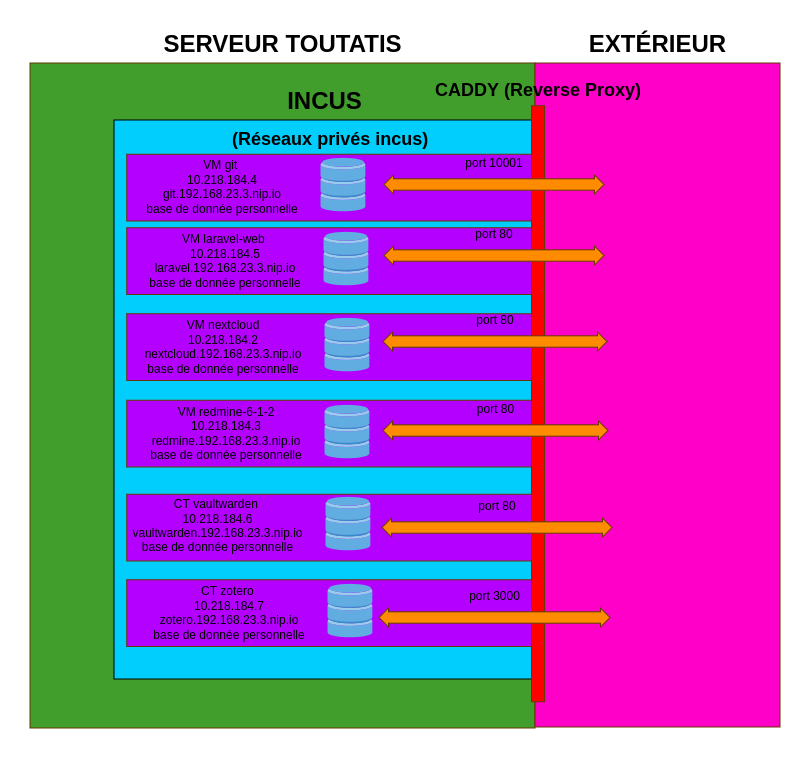

Non, Watchtower ne fait pas de snapshot automatique avant la mise à jour. Le plus propre pour nous, ce serait un script côté Incus et quand une nouvelle version est disponible, il crée un snapshot (la nuit), lance la mise à jour (la nuit), puis envoie une alerte (les snapshots sont gérés avec incus).On a fait un nouveau schéma du serveur pour répondre à Alexander.

| Schéma serveur |

|---|

|

Pour la recherche de theme compatible avec la version de Redmine-6.1.2, nous avons vu que le theme utilisé pour la version de Redmine-5.0.5 etait PurpleMine2 et on a trouvé Opale (qui un fork de PurpleMine2, car il est devenu "archived").

Le problème, c'est que le thème Opale n'a pas de "dark mode" donc il faut le modifier pour pouvoir en avoir un et aussi changer les couleurs du thème pour correspondre à l'ancien (le vert du fablab).

Commande pour changer le thème :

RAILS_ENV=production bundle exec rails console

Setting.ui_theme = 'opale-1.6.7'

exit

Pour appliquer :

bundle exec rake assets:precompile RAILS_ENV=production

systemctl restart apache2

https://github.com/fraoustin/redmine_dark

https://www.redmine.org/plugins/redmine_dark

https://github.com/gagnieray/opale

https://www.redmine.org/projects/redmine/wiki/Theme_List

Jour 23: Mercredi 29 avril 2026¶

On a mis à jour le schéma du serveur pour répondre à la demande d'Alexander :

| Schéma serveur |

|---|

|

Nous avons fait des ajustements sur le thème Opale pour le rendre sombre et vert comme l'ancien thème sur le Redmine-5.0.5 et nous avons aussi commencé à faire un script pour maintenir le serveur à jour tout en créant avant les mises à jour, des snapshots pour chaque service (puis plus tard des alertes, mais pas encore).

Jour 24: Jeudi 30 avril 2026¶

Début de script pour les snapshot :

#!/bin/bash

# ============================================================

# incus-auto-update.sh

# Snapshot + Mise à jour automatique des instances Incus

# Conteneurs (CT) : Docker Compose pull & up

# Machines Virtuelles (VM) : apt update & full-upgrade

# ============================================================

# ─── CONFIGURATION ──────────────────────────────────────────

# Durée de rétention des snapshots avant suppression automatique

SNAPSHOT_EXPIRY="7d"

# Répertoire de logs

LOG_DIR="/var/log/incus-updates"

LOG_FILE="${LOG_DIR}/update-$(date +%Y-%m-%d).log"

# ─── INSTANCES ──────────────────────────────────────────────

# Conteneurs (CT) avec Docker — chemin vers le docker-compose.yml

declare -A CT_COMPOSE_PATHS=(

["vaultwarden"]="/opt/vaultwarden"

["zotero"]="/opt/zotero"

)

# Machines Virtuelles (VM) — mise à jour apt

VMS=("git" "laravel-web" "nextcloud" "redmine-6-1-2")

# ─── FONCTIONS ──────────────────────────────────────────────

log() {

echo "[$(date '+%Y-%m-%d %H:%M:%S')] $1" | tee -a "$LOG_FILE"

}

send_notification() {

local message="$1"

local payload

curl -s -X POST -H "Content-Type: application/json" \

-d "$payload" "$WEBHOOK_URL" > /dev/null 2>&1

}

create_snapshot() {

local instance="$1"

local snap_name="$2"

log " Création du snapshot '$snap_name' pour '$instance'..."

if incus snapshot create "$instance" "$snap_name" --expiry "$SNAPSHOT_EXPIRY" >> "$LOG_FILE" 2>&1; then

log " Snapshot '$snap_name' créé (expiration : $SNAPSHOT_EXPIRY)"

return 0

else

log " Échec de création du snapshot pour '$instance'"

return 1

fi

}

update_container_docker() {

local instance="$1"

local compose_path="$2"

local snap_name="$3"

log " [$instance] Vérification des mises à jour Docker..."

# Récupère les images (pull)

incus exec "$instance" -- bash -c "cd '$compose_path' && docker compose pull" >> "$LOG_FILE" 2>&1

PULL_STATUS=$?

if [ $PULL_STATUS -ne 0 ]; then

log " [$instance] Impossible de pull les images Docker. Vérifiez la connexion."

send_notification " **[$instance]** Échec du pull Docker. Mise à jour annulée. Snapshot disponible : \`$snap_name\`"

return 1

fi

# Recrée les conteneurs si une nouvelle image est disponible

incus exec "$instance" -- bash -c "cd '$compose_path' && docker compose up -d --remove-orphans" >> "$LOG_FILE" 2>&1

UP_STATUS=$?

if [ $UP_STATUS -eq 0 ]; then

log " [$instance] Conteneurs Docker mis à jour avec succès."

# Nettoyage des anciennes images inutilisées

incus exec "$instance" -- bash -c "docker image prune -f" >> "$LOG_FILE" 2>&1

send_notification " **[$instance]** Mise à jour Docker réussie. Snapshot de secours : \`$snap_name\`"

else

log " [$instance] Échec de la mise à jour Docker."

send_notification " **[$instance]** Échec mise à jour Docker.\nRestauration possible avec :\n\`incus restore $instance $snap_name\`"

fi

return $UP_STATUS

}

update_vm_apt() {

local instance="$1"

local snap_name="$2"

log " [$instance] Lancement de apt update & full-upgrade..."

incus exec "$instance" -- bash -c \

"apt-get update -qq && apt-get full-upgrade -y && apt-get autoremove -y && apt-get clean" \

>> "$LOG_FILE" 2>&1

APT_STATUS=$?

if [ $APT_STATUS -eq 0 ]; then

log " [$instance] Paquets mis à jour avec succès."

send_notification " **[$instance]** apt full-upgrade réussi. Snapshot de secours : \`$snap_name\`"

else

log " [$instance] Échec de apt full-upgrade."

send_notification " **[$instance]** Échec apt full-upgrade.\nRestauration possible avec :\n\`incus restore $instance $snap_name\`"

fi

return $APT_STATUS

}

# ─── MAIN ───────────────────────────────────────────────────

mkdir -p "$LOG_DIR"

DATE=$(date +%Y-%m-%d_%H-%M)

log "======================================================"

log " Démarrage des mises à jour automatiques Incus"

log "======================================================"

send_notification " **Incus Auto-Update** démarré ($(date '+%d/%m/%Y %H:%M'))"

# ── Conteneurs Docker (CT) ──────────────────────────────────

for INSTANCE in "${!CT_COMPOSE_PATHS[@]}"; do

SNAP_NAME="pre-update-${DATE}"

COMPOSE_PATH="${CT_COMPOSE_PATHS[$INSTANCE]}"

log ""

log "── CT : $INSTANCE ──────────────────────────────────"

if create_snapshot "$INSTANCE" "$SNAP_NAME"; then

update_container_docker "$INSTANCE" "$COMPOSE_PATH" "$SNAP_NAME"

else

send_notification " **[$INSTANCE]** Snapshot impossible. Mise à jour annulée par sécurité."

fi

done

# ── Machines Virtuelles (VM) ────────────────────────────────

for INSTANCE in "${VMS[@]}"; do

SNAP_NAME="pre-update-${DATE}"

log ""

log "── VM : $INSTANCE ──────────────────────────────────"

if create_snapshot "$INSTANCE" "$SNAP_NAME"; then

update_vm_apt "$INSTANCE" "$SNAP_NAME"

else

send_notification " **[$INSTANCE]** Snapshot impossible. Mise à jour annulée par sécurité."

fi

done

log ""

log "======================================================"

log " Traitement terminé."

log "======================================================"

send_notification "**Incus Auto-Update** terminé. Logs : \`$LOG_FILE\`"

# Nettoyage des logs de plus de 30 jours

find "$LOG_DIR" -name "*.log" -mtime +30 -delete

Jour 25: Vendredi 01 mai 2026¶

Férié

Jour 26: Lundi 04 mai 2026¶

Nous avons essayé de modifier le thème en dark mode pour Redmine 6.1.2, mais en analysant plus en détaille, il y a des menus qui ont disparu et d'autre incompatibilité donc nous avons mis à jour le Redmine vers la 5.1.12 qui est compatible (l'ancienne version 5.0.5).

Nous travaillons maintenant sur le script qui permettra de faire des snapshots et mettre à jour les instance d'incus :

Pour Nextcloud :

Pour le mettre à jour :

sudo -u www-data php /var/www/html/nextcloud/updater/updater.phar

Pour pouvoir le mettre à jour, il faut l'installer depuis l'interface graphique sur la page web, mais pour cela, il faut donner les droits et créer la base avec un user :

chown -R www-data:www-data /var/www/html/nextcloud/

chmod -R 750 /var/www/html/nextcloud/config/

chmod 640 /var/www/html/nextcloud/config/config.php

sudo mysql -u root -p

CREATE DATABASE nextcloud CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci;

CREATE USER 'nextcloud'@'localhost' IDENTIFIED BY 'Fablab';

GRANT ALL PRIVILEGES ON nextcloud.* TO 'nextcloud'@'localhost';

FLUSH PRIVILEGES;

EXIT;

Pour connaitre sa version :

sudo -u www-data php /var/www/html/nextcloud/occ status

ou

cat /var/www/html/nextcloud/version.php

Pour Zotero :

Pour le mettre à jour :

docker pull lscr.io/linuxserver/zotero:latest

docker stop zotero

docker rm zotero

docker run -d --name=zotero -e PUID=1000 -e PGID=1000 -e TZ=Etc/UTC -p 3000:3000 -p 3001:3001 -v /opt/zotero:/config --shm-size="1gb" --restart unless-stopped lscr.io/linuxserver/zotero:latest

Pour connaitre sa version :

docker inspect -f '{{ index .Config.Labels "build_version" }}' zotero

Pour Vaultwarden :

Pour le mettre à jour :

cd /opt/vaultwarden && docker compose pull && docker compose up -d

Pour connaitre sa version :

docker exec -it vaultwarden /vaultwarden --version

Pour Laravel et Redmine :

Nous ne mettons que a jour les paquets Apt pour éviter de casser les deux services :

apt update && apt -y full-upgrade && apt autoremove -y && apt clean

Pour Git-Forgejo :

Pour le mettre à jour :

cd /opt/forgejo && docker compose pull && docker compose up -d

Pour connaitre sa version :

docker exec -it forgejo forgejo --version

Admin :

ID : Fablab

MdP : FablabForgejo

Et nous avons donc mis à jour le script des snapshots et maj :

#!/bin/bash

# ============================================================

# incus-auto-update.sh

# Snapshot automatique + mise à jour de toutes les instances

# Planifier via crontab : 0 3 * * * /usr/local/bin/incus-auto-update.sh

# ============================================================

DATE=$(date +%Y-%m-%d_%H-%M)

LOG="/var/log/incus-updates.log"

log() {

echo "[$(date '+%Y-%m-%d %H:%M:%S')] $1" | tee -a "$LOG"

}

update_instance() {

local INSTANCE=$1

local CMD=$2

local SNAP_NAME="pre-update-${DATE}"

log "=== Traitement de $INSTANCE ==="

# 1. Snapshot avant mise à jour

log "Création du snapshot $SNAP_NAME..."

if incus snapshot create "$INSTANCE" "$SNAP_NAME"; then

log "Snapshot créé avec succès."

# 2. Mise à jour

log "Lancement de la mise à jour..."

if incus exec "$INSTANCE" -- bash -c "$CMD"; then

log "Mise à jour réussie pour $INSTANCE."

else

log "Échec de la mise à jour pour $INSTANCE."

log "Pour restaurer : incus restore $INSTANCE $SNAP_NAME"

fi

else

log "Échec de création du snapshot pour $INSTANCE. Mise à jour annulée."

fi

}

# ============================================================

# Définition des instances et de leurs commandes de mise à jour

# ============================================================

# VM laravel

#update_instance "laravel" "apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean"

# VM Redmine

#update_instance "redmine" "apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean"

# VM nextcloud

#update_instance "nextcloud" "apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean && sudo -u www-data php /var/www/html/nextcloud/updater/updater.phar"

# Conteneur git-forgejo

#update_instance "git" "cd /opt/forgejo && docker compose pull && docker compose up -d"

# Conteneur vaultwarden

#update_instance "vaultwarden" "cd /opt/vaultwarden && docker compose pull && docker compose up -d"

# Conteneur zotero

#update_instance "zotero" 'docker pull lscr.io/linuxserver/zotero:latest && if [ "$(docker inspect --format "{{.Id}}" lscr.io/linuxserver/zotero:latest)" != "$(docker inspect --format "{{.Image}}" zotero)" ]; then docker stop zotero && docker rm zotero && docker run -d --name=zotero -e PUID=1000 -e PGID=1000 -e TZ=Etc/UTC -p 3000:3000 -p 3001:3001 -v /opt/zotero:/config --shm-size="1gb" --restart unless-stopped lscr.io/linuxserver/zotero:latest; else echo "Zotero est deja a jour"; fi'

log "=== Toutes les instances ont été traitées. ==="

Jour 27: Mardi 05 mai 2026¶

Nous avons recréé git-forgejo mais en conteneur (car c'est plus simple pour le maintenir à jour) :

sudo incus shell git

apt update && apt install -y docker.io docker-compose

mkdir -p /opt/forgejo && cd /opt/forgejo

vi docker-compose.yml

services:

server:

image: codeberg.org/forgejo/forgejo:15

container_name: forgejo

environment:

- USER_UID=1000

- USER_GID=1000

- FORGEJO__database__DB_TYPE=postgres

- FORGEJO__database__HOST=db:5432

- FORGEJO__database__NAME=forgejo

- FORGEJO__database__USER=forgejo

- FORGEJO__database__PASSWD=Zo0EiPha

restart: always

volumes:

- ./forgejo-data:/data

- /etc/localtime:/etc/localtime:ro

ports:

- "3000:3000"

- "2222:2222"

depends_on:

- db

db:

image: postgres:14

restart: always

environment:

- POSTGRES_USER=forgejo

- POSTGRES_PASSWORD=Zo0EiPha

- POSTGRES_DB=forgejo

volumes:

- ./postgres-data:/var/lib/postgresql/data

docker compose up -d

docker compose stop server

exit

sudo incus file push forgejo-db.sql git/root/.

sudo incus push forgejo-repos.zip git/root/.

sudo incus push forgejo.zip git/root/.

sudo incus shell git

cp /root/forgejo-db.sql .

cat forgejo-db.sql | docker compose exec -T db psql -U forgejo -d forgejo

cd

unzip forgejo.zip

unzip forgejo-repos.zip

mv var/lib/forgejo/data/* /opt/forgejo/forgejo-data/

cd /opt/forgejo/

chown -R 1000:1000 forgejo-data

chown -R 1000:1000 forgejo-data/git/.ssh

docker compose start server

docker compose logs -f server

docker exec -it forgejo forgejo --version

En interface graphique :

Base de données :| Champ | Valeur |

| Type | PostgreSQL |

| Hôte | bd:5432 |

| Nom d'utilisateur | forgejo |

| Mot de passe | Zo0EiPha |

| Nom de base de données | forgejo |

| Champ | Valeur |

| Titre du site | Forgejo Fablab Cohabit |

| Emplacement racine des dépôts | /data/git/gitea-repositories |

| Répertoire racine Git LFS | /data/git/lfs |

| Exécuter avec le compte | forgejo |

| Port SSH | 2222 |

| Port HTTP | 3000 |

| Champ | Valeur |

| Nom d'utilisateur | Fablab |

| admin@mail.com | |

| Mot de passe | FablabForgejo |

Les maj pour passenger ne passé, car les clés ne sont plus signées donc nous avons fait cela :

curl https://oss-binaries.phusionpassenger.com/auto-software-signing-gpg-key-2025.txt \

| gpg --dearmor \

| sudo tee /etc/apt/trusted.gpg.d/phusion.gpg > /dev/null

sudo apt-get update

Nous avons mis à jour le script pour les maj auto avec leurs pre-snapshots :

#!/bin/bash

# ============================================================

# incus-auto-update.sh

# Snapshot automatique + mise à jour de toutes les instances

# Planifier via crontab : 0 1 * * 6 /usr/local/bin/incus-auto-update.sh

# ============================================================

LOG="/var/log/incus-updates.log"

log() {

echo "[$(date '+%Y-%m-%d %H:%M:%S')] $1" | tee -a "$LOG"

}

# Nettoie une version pour être valide dans un nom de snapshot Incus

# (supprime tout caractère autre que lettres, chiffres, point, tiret, underscore)

sanitize_version() {

echo "$1" | sed 's/[^a-zA-Z0-9._-]/-/g'

}

# ============================================================

# Récupère la version d'une image Docker dans une instance

# Usage : get_docker_version <instance> <image_name>

# ============================================================

get_docker_version() {

local INSTANCE=$1

local IMAGE=$2

local VERSION

VERSION=$(incus exec "$INSTANCE" -- docker inspect --format '{{index .Config.Labels "org.opencontainers.image.version"}}' "$IMAGE" 2>/dev/null)

if [ -z "$VERSION" ]; then

VERSION=$(incus exec "$INSTANCE" -- docker inspect --format '{{.Config.Image}}' "$IMAGE" 2>/dev/null | awk -F: '{print $2}')

fi

if [ -z "$VERSION" ]; then

VERSION=$(incus exec "$INSTANCE" -- docker inspect --format '{{slice .Id 0 12}}' "$IMAGE" 2>/dev/null)

fi

sanitize_version "${VERSION:-unknown}"

}

# ============================================================

# Récupère la version de Forgejo via commande interne

# Usage : get_forgejo_version <instance>

# ============================================================

get_forgejo_version() {

local INSTANCE=$1

local VERSION

VERSION=$(incus exec "$INSTANCE" -- docker exec forgejo forgejo --version 2>/dev/null \

| grep -oP '(?<=version )\S+')

sanitize_version "${VERSION:-unknown}"

}

# ============================================================

# Récupère la version de Nextcloud via occ

# Usage : get_nextcloud_version <instance>

# ============================================================

get_nextcloud_version() {

local INSTANCE=$1

local VERSION

VERSION=$(incus exec "$INSTANCE" -- sudo -u www-data php /var/www/html/nextcloud/occ status 2>/dev/null \

| grep "version:" \

| awk '{print $3}')

sanitize_version "${VERSION:-unknown}"

}

# ============================================================

# Fonction principale de mise à jour

# Usage : update_instance <instance> <snap_name> <commande_update>

# ============================================================

update_instance() {

local INSTANCE=$1

local SNAP_NAME=$2

local CMD=$3

log "=== Traitement de $INSTANCE (snapshot : $SNAP_NAME) ==="

# 1. Snapshot avant mise à jour

log "Création du snapshot $SNAP_NAME..."

if incus snapshot create "$INSTANCE" "$SNAP_NAME"; then

log "Snapshot créé avec succès."

# 2. Mise à jour

log "Lancement de la mise à jour..."

if incus exec "$INSTANCE" -- bash -c "$CMD"; then

log "Mise à jour réussie pour $INSTANCE."

else

log "Échec de la mise à jour pour $INSTANCE."

log "Pour restaurer : incus restore $INSTANCE $SNAP_NAME"

fi

else

log "Échec de création du snapshot pour $INSTANCE. Mise à jour annulée."

fi

}

# ============================================================

# Définition des instances et de leurs commandes de mise à jour

# ============================================================

# VM laravel — version fixe

update_instance "laravel" "pre-update_laravel-9.52.10" \

"apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean"

# VM redmine — version fixe

update_instance "redmine" "pre-update_redmine-5.1.12" \

"apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean"

# VM nextcloud — version récupérée via occ

VERSION=$(get_nextcloud_version "nextcloud")

update_instance "nextcloud" "pre-update_nextcloud-${VERSION}" \

"apt-get update && apt-get -y full-upgrade && apt-get autoremove -y && apt-get clean && sudo -u www-data php /var/www/html/nextcloud/updater/updater.phar"

# Conteneur git-forgejo — version via commande interne

VERSION=$(get_forgejo_version "git")

update_instance "git" "pre-update_forgejo-${VERSION}" \

"cd /opt/forgejo && docker compose pull && docker compose up -d"

# Conteneur vaultwarden — version de l'image Docker

VERSION=$(get_docker_version "vaultwarden" "vaultwarden/server")

update_instance "vaultwarden" "pre-update_vaultwarden-${VERSION}" \

"cd /opt/vaultwarden && docker compose pull && docker compose up -d"

# Conteneur zotero — version de l'image Docker

VERSION=$(get_docker_version "zotero" "lscr.io/linuxserver/zotero")

update_instance "zotero" "pre-update_zotero-${VERSION}" \